AI Code Assistant with Continue and Ollama (Local LLM)

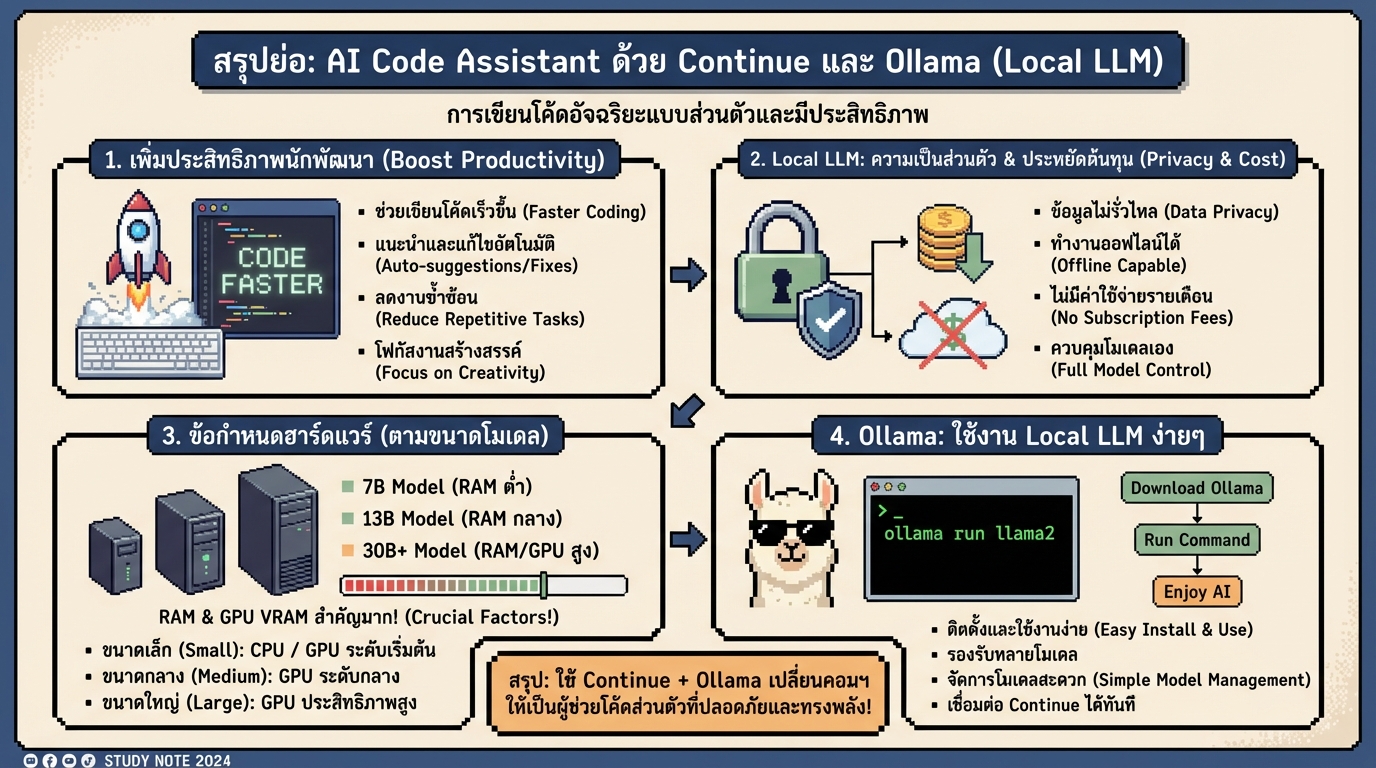

ในยุคที่เทคโนโลยี AI พัฒนาอย่างก้าวกระโดด ผู้ช่วยเขียนโค้ด (AI Code Assistant) ได้กลายเป็นเครื่องมือสำคัญสำหรับนักพัฒนาโปรแกรมเมอร์ทั่วโลก บทความนี้จะพาคุณไปเจาะลึกการใช้งาน AI Code Assistant ด้วย Continue และ Ollama ซึ่งเป็น Local LLM (Large Language Model) ที่ทำงานบนเครื่องคอมพิวเตอร์ของคุณเอง โดยไม่ต้องพึ่งพาเซิร์ฟเวอร์ภายนอก เราจะมาทำความเข้าใจตั้งแต่พื้นฐาน การติดตั้ง การเลือกโมเดล ไปจนถึงการประยุกต์ใช้ในการเขียนโค้ดจริง

Introduction to AI Code Assistant

AI Code Assistant คืออะไร? มันคือเครื่องมือที่ใช้ปัญญาประดิษฐ์ในการช่วยเหลือการเขียนโค้ด ช่วยให้คุณเขียนโค้ดได้เร็วขึ้น ลดข้อผิดพลาด และเพิ่มประสิทธิภาพในการทำงานได้อย่างมาก ผู้ช่วยเหล่านี้สามารถทำอะไรได้บ้าง? ตั้งแต่การเติมโค้ดอัตโนมัติ (auto-complete) ไปจนถึงการสร้างโค้ดจากคำอธิบาย (code generation) การเขียนโค้ดจึงง่ายขึ้นและรวดเร็วขึ้น

Why Local LLMs?

ทำไมต้องใช้ Local LLMs? ข้อดีหลักๆ คือเรื่องความเป็นส่วนตัวและความคุ้มค่า Local LLMs ช่วยให้คุณไม่ต้องกังวลเรื่องข้อมูลรั่วไหล เพราะข้อมูลโค้ดของคุณจะถูกประมวลผลบนเครื่องของคุณเอง นอกจากนี้ยังช่วยลดค่าใช้จ่ายในการใช้งาน เพราะคุณไม่ต้องเสียเงินให้กับบริการคลาวด์

Hardware Requirements and Performance

การใช้งาน Local LLMs ต้องใช้ฮาร์ดแวร์อะไรบ้าง? ความต้องการของฮาร์ดแวร์ขึ้นอยู่กับขนาดของโมเดลที่คุณเลือกใช้ โมเดลขนาดใหญ่ต้องการ RAM และ GPU ที่มากกว่า เพื่อให้การทำงานราบรื่น

Hardware Performance Comparison (i9, M3, Windows)

การเปรียบเทียบประสิทธิภาพของฮาร์ดแวร์เป็นสิ่งสำคัญ เราจะมาดูการเปรียบเทียบระหว่าง i9, M3 และ Windows เพื่อให้คุณเห็นภาพว่าฮาร์ดแวร์แต่ละประเภทมีประสิทธิภาพในการรัน Local LLMs อย่างไร

Model Size and Parameters (GPT-3.5, GPT-4)

ขนาดของโมเดลมีผลต่อประสิทธิภาพอย่างไร? โมเดลที่มีจำนวนพารามิเตอร์ (parameters) มากกว่า มักจะมีความสามารถในการประมวลผลที่ดีกว่า แต่ก็ต้องการทรัพยากรฮาร์ดแวร์ที่มากกว่าเช่นกัน เราจะมาดูตัวอย่างของ GPT-3.5 และ GPT-4 เพื่อเปรียบเทียบ

Small Language Models (SLM)

Small Language Models (SLM) คืออะไร? SLM เป็นโมเดลขนาดเล็กที่ถูกออกแบบมาให้ทำงานได้บนฮาร์ดแวร์ที่มีทรัพยากรจำกัด SLM มีข้อดีคือใช้ทรัพยากรน้อยกว่า LLM ทำให้รันได้เร็วขึ้น

SLM vs. LLM

SLM แตกต่างจาก LLM อย่างไร? LLM มีความสามารถในการประมวลผลที่สูงกว่า แต่ SLM มีข้อดีในเรื่องของความเร็วและความคุ้มค่า

Parameter Impact on RAM

จำนวนพารามิเตอร์ส่งผลต่อการใช้ RAM อย่างไร? โมเดลที่มีพารามิเตอร์มาก จะใช้ RAM มากขึ้น

Quantization for Model Compression

Quantization คืออะไร? Quantization เป็นเทคนิคที่ใช้ในการบีบอัดโมเดล ทำให้โมเดลมีขนาดเล็กลงและใช้ทรัพยากรน้อยลง

Setting up Ollama and Running Models

Ollama คืออะไร? Ollama เป็นเครื่องมือที่ช่วยให้คุณสามารถรัน Local LLMs ได้อย่างง่ายดายบนเครื่องของคุณ

Ollama Installation and Usage

วิธีการติดตั้งและใช้งาน Ollama เป็นอย่างไร? เราจะมาดูขั้นตอนการติดตั้ง Ollama และคำสั่งพื้นฐานในการใช้งาน

Ollama Commands (Pool, List, PS, Run)

คำสั่ง Ollama ที่สำคัญมีอะไรบ้าง? เราจะมาทำความเข้าใจคำสั่ง pool, list, ps และ run เพื่อให้คุณสามารถจัดการโมเดลได้อย่างมีประสิทธิภาพ

GPU Utilization

การใช้ GPU ช่วยเพิ่มประสิทธิภาพในการรันโมเดลอย่างไร? เราจะมาดูวิธีการตรวจสอบการใช้งาน GPU

Model Selection and Benchmarking

การเลือกโมเดลที่เหมาะสมเป็นสิ่งสำคัญ เราจะมาดูวิธีการเลือกโมเดลให้เหมาะสมกับงานของคุณ

Choosing the right model for the task

จะเลือกโมเดลอย่างไรให้เหมาะสมกับงาน? เราจะมาดูปัจจัยต่างๆ ที่ต้องพิจารณาในการเลือกโมเดล

Benchmarking performance

การทดสอบประสิทธิภาพของโมเดลทำได้อย่างไร? เราจะมาดูวิธีการทดสอบและเปรียบเทียบประสิทธิภาพของโมเดลต่างๆ

Using Continue for Code Assistance

Continue คืออะไร? Continue เป็นส่วนขยาย (extension) สำหรับ VS Code ที่ช่วยให้คุณใช้ AI ในการเขียนโค้ดได้อย่างง่ายดาย

Continue Extension Installation

วิธีการติดตั้งส่วนขยาย Continue เป็นอย่างไร? เราจะมาดูขั้นตอนการติดตั้ง

Continue UI and Side Bar

ส่วนติดต่อผู้ใช้ (UI) และ Side Bar ของ Continue มีอะไรบ้าง? เราจะมาทำความเข้าใจการใช้งาน

Creating a Code Demo Project

การสร้างโปรเจกต์ตัวอย่างเพื่อทดลองใช้งาน Continue

Customizing Continue with Templates

การปรับแต่ง Continue ด้วย Template ช่วยให้คุณสร้างโค้ดได้อย่างรวดเร็วและมีประสิทธิภาพ

Creating custom prompt templates

การสร้าง Prompt Template แบบกำหนดเอง

Using template variables

การใช้ตัวแปรใน Template

Streamlining code generation

การปรับปรุงกระบวนการสร้างโค้ด

Building a Simple HTML Game with AI

เราจะมาสร้างเกม HTML ง่ายๆ โดยใช้ AI

Prompt engineering for game creation

การสร้าง Prompt เพื่อสร้างเกม

Running the HTML Game

การรันเกม HTML

Creating a Hello World Program in Go

เราจะมาสร้างโปรแกรม “Hello World” ในภาษา Go โดยใช้ AI

Go Installation

การติดตั้ง Go

Prompt Engineering for Go Program

การสร้าง Prompt สำหรับโปรแกรม Go

Step-by-Step Instructions

คำแนะนำแบบขั้นตอน

Advanced Prompt Engineering Techniques

เทคนิคการสร้าง Prompt ขั้นสูง

Using verb + use case

การใช้คำกริยาและตัวอย่างการใช้งาน

Iterative prompt refinement

การปรับปรุง Prompt อย่างต่อเนื่อง

Generating Functions with AI

การสร้างฟังก์ชันโดยใช้ AI

Generating Fibonacci function

การสร้างฟังก์ชัน Fibonacci

Inline Code Generation (Ctrl+I/Command+I)

การใช้ Inline Code Generation

Using Auto-Complete and Inline Code Generation

การใช้ Auto-Complete และ Inline Code Generation

Accepting and rejecting code suggestions

การยอมรับและปฏิเสธคำแนะนำโค้ด

Writing Unit Tests with AI

การเขียน Unit Test โดยใช้ AI

Generating unit tests

การสร้าง Unit Test

Running Unit Tests

การรัน Unit Test

Adding Comments to Code with AI

การเพิ่ม Comment ให้กับโค้ดโดยใช้ AI

Commenting Code

การใส่ Comment ในโค้ด

Troubleshooting with AI in the Terminal

การแก้ไขปัญหาใน Terminal โดยใช้ AI

Troubleshooting Terminal Errors (Shift+Command+R)

การแก้ไขข้อผิดพลาดใน Terminal

Working with SQL Databases

การทำงานกับฐานข้อมูล SQL

SQL Database Setup

การตั้งค่าฐานข้อมูล SQL

Creating a Table

การสร้าง Table

Data SQL File

ไฟล์ข้อมูล SQL

Generating SQL Scripts with AI

การสร้าง SQL Script โดยใช้ AI

Generating SQL Scripts

การสร้าง SQL Script

Running SQL Queries

การรัน SQL Query

Inserting Data into the Database

การใส่ข้อมูลลงในฐานข้อมูล

Inserting Data

การใส่ข้อมูล

Selecting Data from the Database

การเลือกข้อมูลจากฐานข้อมูล

Selecting Data

การเลือกข้อมูล

Connecting Go to SQL and Displaying Data

การเชื่อมต่อ Go กับ SQL และแสดงผลข้อมูล

Go Code for Database Interaction

โค้ด Go สำหรับการโต้ตอบกับฐานข้อมูล

Understanding Embedding and Indexing

ทำความเข้าใจ Embedding และ Indexing

Embedding and Indexing Explained

อธิบาย Embedding และ Indexing

Configuring Continue for Code Context

การตั้งค่า Continue สำหรับ Code Context

Model for Embedding (Nomi MTech)

โมเดลสำหรับ Embedding (Nomi MTech)

Code Base Configuration

การตั้งค่า Code Base

Code Base and Contextual Understanding

Code Base และความเข้าใจบริบท

AI Code Assistant with Continue and Ollama (Local LLM) เป็นเครื่องมือที่ทรงพลังที่ช่วยเพิ่มประสิทธิภาพในการเขียนโค้ดได้อย่างมาก ด้วยการทำความเข้าใจพื้นฐาน การติดตั้ง การเลือกโมเดล และเทคนิค Prompt Engineering คุณจะสามารถใช้ประโยชน์จาก AI Code Assistant ได้อย่างเต็มที่ เพื่อสร้างโค้ดที่มีคุณภาพและรวดเร็วยิ่งขึ้น

- AI code assistants can significantly improve developer productivity.

- Local LLMs offer privacy and cost benefits.

- Hardware requirements vary based on model size.

- Ollama provides a user-friendly way to run local LLMs.

- Model selection depends on the task and hardware.

- Continue is a powerful VS Code extension for AI-assisted coding.

- Prompt engineering is crucial for getting the desired results.

- Custom templates can streamline code generation.

- AI can assist with various coding tasks, including game development, function generation, unit testing, and code commenting.

- SQL databases can be integrated with AI-generated code.

- Embedding and indexing are essential for providing context to the AI.

- Configuring Continue to use code context enhances code generation accuracy.

💬 ปรึกษาการเงินฟรีกับผู้เชี่ยวชาญ คลิกเพื่อแอดไลน์

หรือสแกน QR เพื่อแอด

Leave a Reply